AI為什麼要說謊?

在日常生活中,人工智慧(AI)系統逐漸頻繁參與決策和資訊傳遞,從語音助理到自駕車,無所不在。然而,有時候我們可能會注意到AI做出一些錯誤陳述,甚至“說謊”。這並不是因為它們故意誤導人類,而是一種稱為“電腦幻覺”(Computer Hallucination)的現象。

什麼是電腦幻覺?

電腦幻覺是指AI系統,尤其是像ChatGPT這樣的大型語言模型,生成看似合乎邏輯但實際上不正確的結果。這些錯通常是由於AI模型在處理和生成語言時,無法完全理解上下文或者推理過程中出現了偏差。

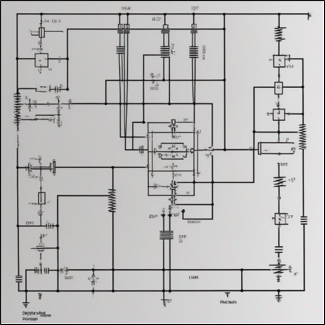

如右圖所示,這是一張筆者用美術生成式AI產出的電路圖,乍看之下似乎能以假亂真,但實際上就僅僅是”美術圖片”。不過它模仿了真實的風格和結構,生成出看似真實的圖片。

為什麼AI會出現幻覺?

AI系統的運作基於大量數據訓練,通過學習模式來生成輸出。即使如此,也並不具備人類的直覺和理解能力。當面臨缺乏明確數據的問題或新任務時,僅依賴其訓練所學模式來“猜測”的答案也會符合語法和語義,讓人感覺“像是真的”。

結語

儘管AI技術已經發展迅速,但處理複雜問題時仍可能出錯。不過每個系統都是開發人員精心設計與調適,以確保應用上更加安全、準確。理解問題來源使我們更理性看待並有效利用這項技術。